إليك سبب عدم الوثوق في ملخصات الأخبار من AI chatbots (مع واحد على وجه الخصوص)

يجب أن تفكر بالتأكيد مرتين قبل استخدام chatbot منظمة العفو الدولية لتوفير ملخص سريع للأخبار. تقرير جديد من بي بي سي يوضح أن chatbots الشعبية تنتج عيوبًا كبيرة في نتائج الملخص.

كان لدى Google Gemini أعلى نسبة من الملخصات الإشكالية

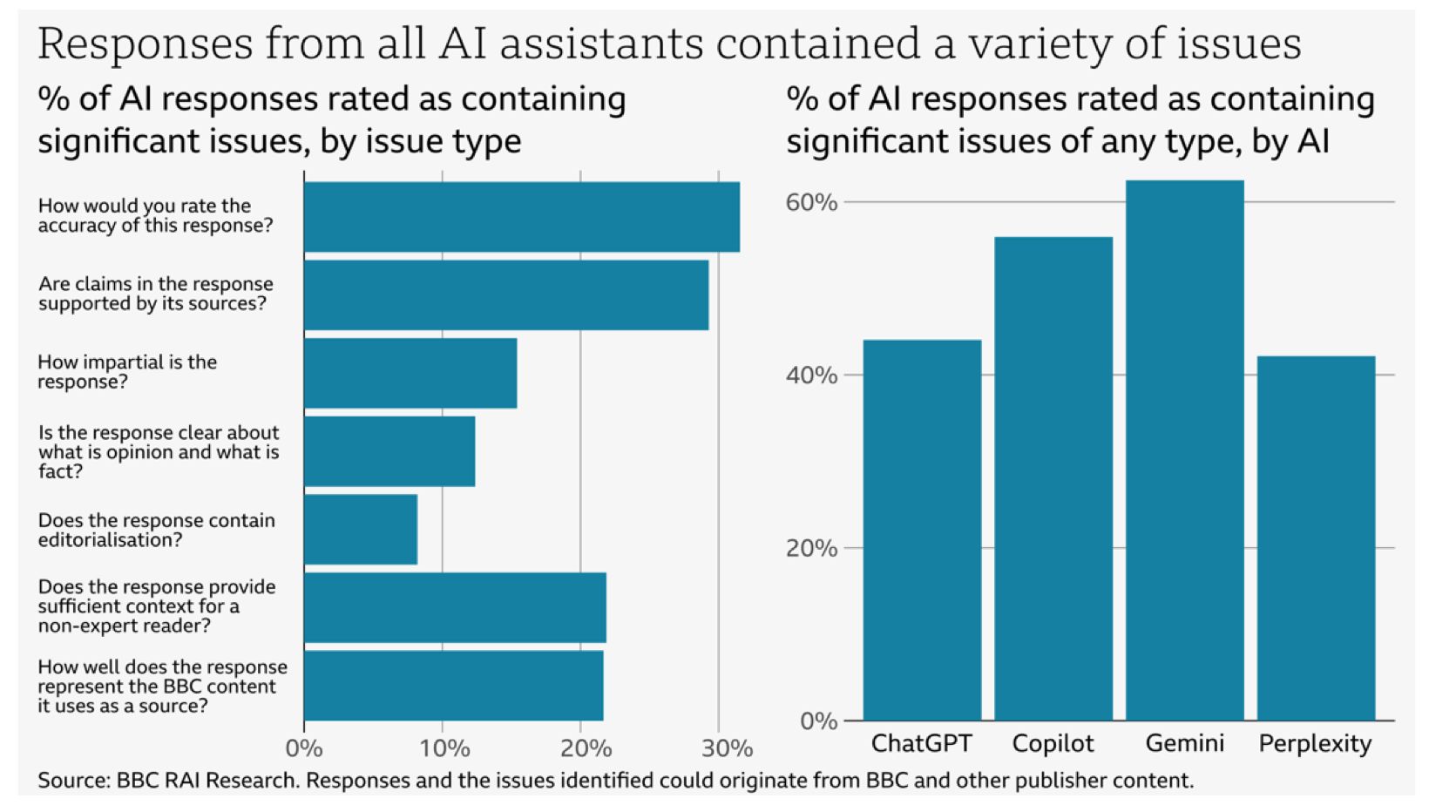

غطى الاختبار ChatGpt و Google Gemini و Microsoft Copilot و Perplexity AI. للبدء ، طرحت هيئة الإذاعة البريطانية (BBC) كل أسئلة على chatbot 100 حول الأخبار ، وطلب منهم استخدام مصادر أخبار بي بي سي حيثما أمكن ذلك.

ثم قام خبراء من بي بي سي بتقييم جودة هذه الملخصات. من بين الملخصات ، كان 51 في المائة نوعًا من الأخطاء ، سواء كان عدم الدقة الواقعية أو الخاطئ أو المعلومات القديمة.

من بين هؤلاء ، كان لدى 19 في المائة نوع من الأخطاء الواقعية مثل تاريخ غير صحيح. وتم تغيير 13 في المائة من الاقتباسات المنسوبة إلى بي بي سي في الملخصات إما من شكلها الأصلي أو لم تكن موجودة في المقالات المقدمة إلى chatbots.

عند تقسيمها بواسطة chatbot ، كان Gemini من Google أسوأ مرتكب الجاني الذي يحتوي على أكثر من 60 في المائة من الملخصات التي تحتوي على معلومات إشكالية. كان Microsoft Copilot التالي بنسبة 50 في المائة بينما كان لدى ChatGpt و Perplexity حوالي 40 في المائة من الاستجابات مع القضايا.

في خاتمة الدراسة ، قالت هيئة الإذاعة البريطانية إن العديد من القضايا كانت أكثر من مجرد معلومات خاطئة:

يشير هذا البحث أيضًا إلى أن نطاق الأخطاء التي قدمها مساعدو الذكاء الاصطناعى أوسع من مجرد عدم الدقة الواقعية. كافح مساعدو الذكاء الاصطناعى الذين اختبرناهم من أجل التمييز بين الرأي والواقع ، والمجتمع التحريري ، وغالبًا ما فشلوا في تضمين السياق الأساسي. حتى عندما يكون كل عبارة في استجابة دقيقة ، يمكن أن تؤدي هذه الأنواع من القضايا إلى استجابات مضللة أو متحيزة.

لم أحاول مطلقًا استخدام chatbot منظمة العفو الدولية لتلخيص الأخبار بسبب الحقيقة البسيطة المتمثلة في أنني لم أثق في موثوقية التكنولوجيا. لكن نتائج الدراسة لا تزال مفاجئة للغاية مع ارتفاع عدد النتائج مع القضايا. لدى الذكاء الاصطناعي طريق طويل جدًا لتصبح وسيلة موثوقة لمعرفة المزيد عن الأخبار.

لا تزال ميزات الذكاء الاصطناعي عملًا مستمرًا

تواصل تقنية الذكاء الاصطناعي ، وخاصة chatbots ، التحسن بسرعة. ولكن كما تظهر دراسة بي بي سي ، فإن توقع المعلومات الصحيحة حول الأخبار هي مجال مشكلة كبيرة.

اشتكت بي بي سي بصوت عالٍ من ميزة أخرى تعمل بالنيابة: ملخصات إشعار شركة Apple Intelligence. في ديسمبر 2024 ، ذكر ملخص الإخطار من المخرج بشكل غير صحيح أن لويجي مانجيون قد أطلق النار على نفسه. وهو مطلق النار المزعوم لرئيس التنفيذي في مجال الرعاية الصحية براين طومسون.

استجابةً لبي بي سي والشكاوى الأخرى ، أوقفت شركة Apple مؤقتًا ملخصات لتطبيقات الأخبار والترفيه بدءًا من iOS 18.3.

لذلك عندما تتطلع إلى اللحاق بالأخبار ، اجعل الأمر بسيطًا: تخطي ملخص AI وقم بالقراءة بنفسك.